关键词:在某一个类别的文章中,出现的次数很多,但是在其他类别的文章当中出现很少

from sklearn.feature_extraction.text import CountVectorizer

import jieba

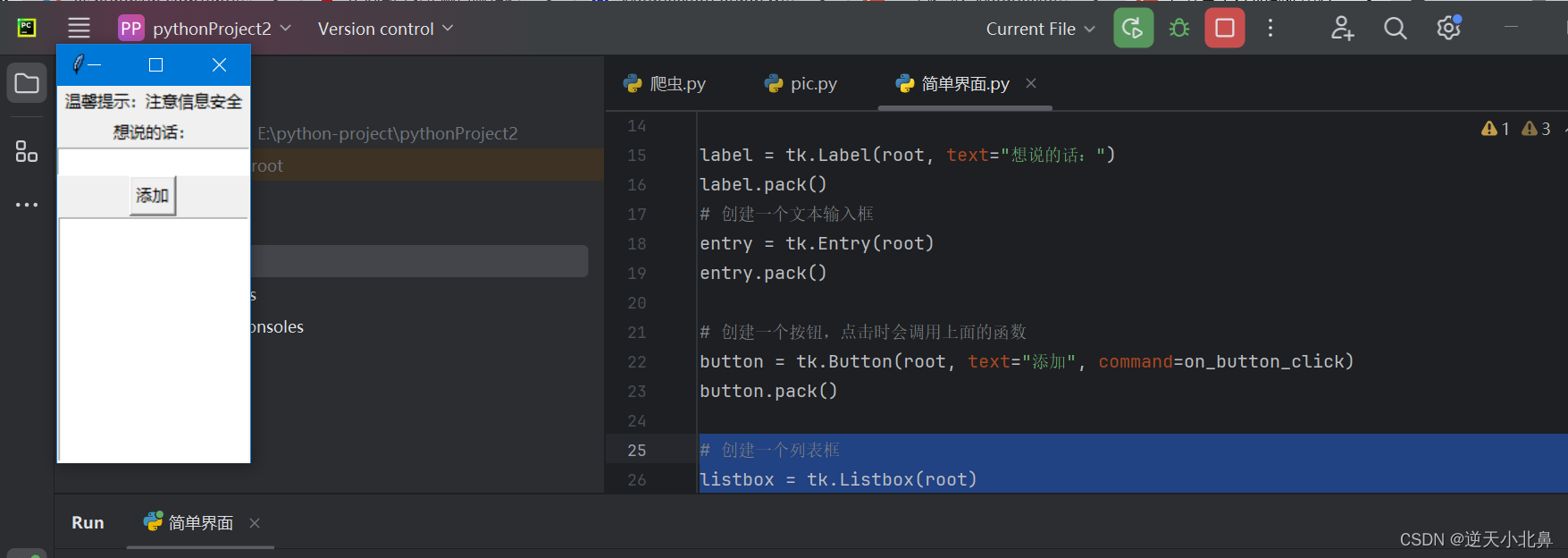

def chinese_text_extraction02():

"""

中文文本特征提取:CountVectorizer

自动分词

:return:

"""

data = ['一种还是一种今天很残酷,明天更残酷,后天很美好,但绝对大部分是死在明天晚上,所以每个人不要放弃今天。',

'我们看到的从很远星系来的光是在几百万年之前发出的,这样当我们看到宇宙时,我们是在看它的过去。',

'如果只用一种方式了解某件事物,他就不会真正了解它。了解事物真正含义的秘密取决于如何将其与我们所了解的事物相联系。']

data_new = []

for sent in data:

data_new.append(cut_word(sent))

print(data_new)

# 1、实例化一个转换器类

transfer = CountVectorizer()

# 2、调用 fit_transform

data_final = transfer.fit_transform(data_new)

print("data_final:\n", data_final.toarray())

print("特征名字:\n", transfer.get_feature_names())

# # 1、实例化一个转换器类

# transfer = CountVectorizer()

# # 2、调用fit_transform

# data_new = transfer.fit_transform(data)

# print("data_new:\n", data_new.toarray()) # toarray转换为二维数组

# print("特征名字:\n", transfer.get_feature_names())

return None

def cut_word(text):

"""

进行中文分词:”我爱北京天安门“ -> ”我 爱 北京 天安门“

:param text:

:return:

"""

# ' ' 空格

return ' '.join(jieba.cut(text))

if __name__ == '__main__':

chinese_text_extraction02()

# print(cut_word('我爱北京天安门'))